Last Updated on február 27, 2024 12:38 du. by Laszlo Szabo / NowadAIs | Published on február 5, 2024 by Juhasz “the Mage” Gabor

Az OpenAI katonai tilalmát csendben feloldották – nyitott kapuk az AI-vezérelt csataterek előtt? – Kulcsfontosságú megjegyzések:

- Politikai váltás: Az OpenAI feloldja a mesterséges intelligencia eszközeinek katonai felhasználására vonatkozó tilalmat.

- Katonai partnerségek: Potenciális együttműködés a védelmi minisztériumokkal, köztük az Egyesült Államok Védelmi Minisztériumával.

- Etikai aggályok: Vita a mesterséges intelligenciáról a hadviselésben, a polgári biztonságról és a mesterséges intelligencia elfogultságáról.

- AzOpenAI álláspontja: A károkozásmentesség és a fegyverfejlesztés tilalmának hangsúlyozása.

- Jövőbeni következmények: A döntés hatással van a mesterséges intelligencia katonai alkalmazásokban betöltött szerepére, és kérdéseket vet fel az etikai irányelvekkel kapcsolatban.

Az OpenAI fordulata

Az OpenAI, a vezető AI-vállalat jelentős irányváltást hajtott végre azzal, hogy csendben feloldotta a fejlett AI-eszközeinek katonai felhasználására vonatkozó tilalmát – ez a döntés felkeltette a Pentagon figyelmét, és kérdéseket vetett fel a lehetséges következményekkel és következményekkel kapcsolatban.

Most az OpenAI irányelvváltásának részleteibe, az azt övező aggodalmakba és a katonai alkalmazásokban alkalmazott mesterséges intelligencia jövőjére gyakorolt lehetséges hatásaiba fogunk belemerülni.

A katonai felhasználás tilalma

Egészen a közelmúltig az OpenAI szigorú irányelvekkel rendelkezett, amelyek tiltották technológiájának katonai és hadviselési célú felhasználását, használták a kifejezést:

“olyan tevékenység, amely nagymértékben veszélyezteti a fizikai sérülést”

A vállalat irányelvei kifejezetten kimondták, hogy modelljeit, például a ChatGPT-t, nem szabad olyan tevékenységekre használni, amelyek magas fizikai sérülés kockázatával járnak, beleértve a fegyverfejlesztést és a katonai alkalmazásokat.

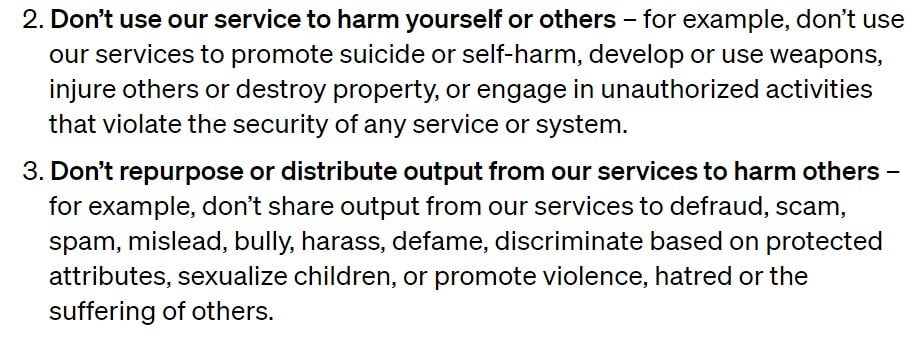

Az OpenAI azonban mostanra eltávolította a katonai célú konkrét utalást az irányelveiből, ugyanakkor továbbra is hangsúlyozza, hogy tilos az eszközeit saját vagy mások sérelmére, illetve fegyverek fejlesztésére vagy használatára használni.

A katonai felhasználásra vonatkozó tilalom eltörlése jelentős eltérésnek tekinthető az OpenAI korábbi álláspontjától, és aggodalmat keltett a szakértők és a megfigyelők körében egyaránt.

Az irányelvek megváltoztatása megnyitja az utat az OpenAI és a védelmi minisztériumok közötti lehetséges partnerségek előtt , beleértve az Egyesült Államok Védelmi Minisztériumát, amely kifejezte érdeklődését a generatív mesterséges intelligencia közigazgatási és hírszerzési műveletekben való felhasználása iránt.

Következmények és kritikák

Az OpenAI irányelvváltozása vitát váltott ki a mesterséges intelligencia katonai alkalmazásokban való alkalmazásának etikai vonatkozásairól.

A kritikusok szerint a mesterséges intelligencia hadviselésben való alkalmazása aggályokat vet fel a civil áldozatokkal, a mesterséges intelligencia rendszerek elfogultságával és a fegyveres konfliktusok lehetséges eszkalációjával kapcsolatban.

Rámutatnak, hogy az olyan AI-modellek, mint a ChatGPT, bár gyakran meggyőzőek, a koherenciát a pontossággal szemben előnyben részesítik, és hallucinációktól szenvedhetnek, ami pontatlan és elfogult műveletekhez vezethet.

Az OpenAI válasza és egyértelműsége

Az OpenAI szóvivője, Niko Felix tisztázta, hogy az irányelvek megváltoztatásának célja az volt, hogy egyértelműséget teremtsen és lehetővé tegye az OpenAI küldetésével összhangban lévő nemzetbiztonsági felhasználási esetekről szóló vitákat:

Célunk egy olyan egyetemes alapelvkészlet létrehozása volt, amelyet könnyű megjegyezni és alkalmazni, különösen mivel eszközeinket most már világszerte használják a mindennapi felhasználók, akik mostantól GPT-ket is készíthetnek. Egy olyan elv, mint a “Ne árts másoknak”, széleskörű, mégis könnyen megfogható és számos kontextusban releváns. Ezen túlmenően a fegyvereket és mások megkárosítását kifejezetten egyértelmű példaként említettük.

Megemlítette a Védelmi Fejlett Kutatási Projektek Ügynökségével (DARPA) való együttműködésüket a kritikus infrastruktúrák és az ipar kiberbiztonsági eszközeinek fejlesztése érdekében. Ennek az együttműködésnek a célja a nemzetbiztonság szempontjából kulcsfontosságú nyílt forráskódú szoftverek védelme.

Felix kijelentette, hogy az OpenAI tisztában van a technológiájuk katonai alkalmazásával kapcsolatos kockázatokkal és károkkal.

Bár a frissített irányelvek eltörlik a katonai és hadviselésre vonatkozó kifejezett tilalmat, a saját és mások számára kárt nem okozó magatartás elve továbbra is érvényes.

Az OpenAI technológiájának bármilyen felhasználása – beleértve a hadsereg általi felhasználást is – fegyverek kifejlesztésére vagy használatára, mások megkárosítására vagy olyan jogosulatlan tevékenységekre, amelyek sértik bármely szolgáltatás vagy rendszer biztonságát, tilos.

A mesterséges intelligencia szerepe a hadseregben

A hadsereg különböző alkalmazásokban vizsgálja a mesterséges intelligenciában rejlő lehetőségeket.

Bár az OpenAI technológiája nem teszi lehetővé közvetlenül a halálos akciókat, de felhasználható az olyan, gyilkossággal szomszédos feladatokban, mint a kódírás vagy a beszerzési megrendelések feldolgozása.

Szakértők azonban azzal érvelnek, hogy még ha az OpenAI eszközeit nem erőszakos célokra vetnék is be egy katonai intézményen belül, akkor is hozzájárulnának egy olyan szervezethez, amelynek elsődleges célja a halálozás.

A mesterséges intelligencia bevonása a katonai hírszerzésbe, a célzási rendszerekbe és a döntéstámogatásba aggályokat vet fel a pontossággal, az elfogultságokkal és a nem szándékolt következmények lehetőségével kapcsolatban.

Etikai iránymutatások szükségessége

Az OpenAI által végrehajtott irányváltás rávilágít amesterséges intelligencia használatára vonatkozó egyértelmű ésátfogó etikai iránymutatások kidolgozásának fontosságára, különösen katonai kontextusban.

A mesterséges intelligencia technológia folyamatos fejlődésével párhuzamosan elengedhetetlen, hogy foglalkozzunk a hadviselésben való alkalmazásával kapcsolatos lehetséges kockázatokkal és következményekkel.

Sarah Myers West, az AI Now Institute ügyvezető igazgatója hangsúlyozza, hogy az OpenAI politikájában szükség van az átláthatóságra és a betartatásra:

Prof. Suchman questions notions of who constitutes an “imminent threat” that are baked into AI-enabled warfighting”, and the legitimacy of this targeting under the Geneva Convention.

2/

— AI Now Institute (@AINowInstitute) January 26, 2024

A megfogalmazás homályossága kérdéseket vet fel azzal kapcsolatban, hogy az OpenAI hogyan kívánja megközelíteni a végrehajtást, és hogy hatékonyan tud-e eligazodni a katonai szerződéskötések és a hadműveletek által támasztott kihívások között.

Következtetés

Az OpenAI azon döntése, hogy feloldja a mesterséges intelligencia eszközeinek katonai felhasználására vonatkozó tilalmat, vitákat váltott ki a mesterséges intelligencia és a hadviselés metszéspontjáról.

Miközben a vállalat célja, hogy egyértelművé tegye és lehetővé tegye a nemzetbiztonsági felhasználási eseteket, továbbra is aggályok merülnek fel a katonai alkalmazásokban alkalmazott mesterséges intelligencia lehetséges következményeivel és etikai vonatkozásaival kapcsolatban.

Mivel az AI területe folyamatosan fejlődik, elengedhetetlen, hogy az OpenAI-hoz hasonló szervezetek szilárd etikai irányelveket dolgozzanak ki, és biztosítsák az AI-technológia felelős fejlesztését és alkalmazását.

A mesterséges intelligencia előnyeinek és kockázatainak katonai kontextusban való kiegyensúlyozása összetett feladat, amely gondos mérlegelést és az emberi életekre és a globális biztonságra gyakorolt lehetséges hatások alapos értékelését igényli.