Last Updated on február 2, 2024 11:29 de. by Laszlo Szabo / NowadAIs | Published on február 2, 2024 by Juhasz “the Mage” Gabor

AI biztonság: A mesterséges intelligencia biztonságos fejlesztése érdekében tett globális erőfeszítések – Főbb megjegyzések

- Globális együttműködés: 30 vezető mesterséges intelligenciával foglalkozó nemzet részvételével.

- Szakértői tanácsadó testület: 32 nemzetközi szakértőből áll.

- Fókuszterületek: Kockázatok, etikai aggályok és a mesterséges intelligencia nem szándékolt következményei.

- Irányadó elvek: Átfogó jelleg, objektivitás, átláthatóság és tudományos értékelés.

- Jövőbeni befolyás: A jövőbeli mesterséges intelligencia biztonsági csúcstalálkozókon folytatott viták alakítása.

A biztonság globális igénye

A mesterséges intelligencia (AI) olyan átalakító technológiává vált, amely hatalmas innovációs és fejlődési potenciállal rendelkezik.

Az egyre kifinomultabbá váló mesterséges intelligencia-rendszerekkel együtt azonban egyre nagyobb szükség van a fejlesztésükkel és alkalmazásukkal kapcsolatos biztonsági aggályok kezelésére.

E probléma megoldása érdekében nemzetközi együttműködés keretében folyamatban van a fejlett mesterséges intelligencia biztonságáról szóló első nemzetközi tudományos jelentés elkészítése.

Bevezetés a mesterséges intelligencia biztonságába

A mesterséges intelligencia biztonsága vagy AI Safety (mesterséges intelligencia biztonsága) a mesterséges intelligencia rendszerek biztonságos és felelősségteljes fejlesztésének és használatának biztosítása érdekében hozott intézkedésekre utal.

Ez magában foglalja a mesterséges intelligenciával kapcsolatos kockázatok és kihívások kezelését, például a lehetséges elfogultságok, etikai aggályok és nem szándékolt következmények kezelését.

A fejlett mesterséges intelligencia biztonságáról szóló nemzetközi tudományos jelentés célja, hogy átfogó képet nyújtson a határterületi mesterséges intelligencia ezen kockázatairól és képességeiről.

Szakértői tanácsadó testület: Globális együttműködés

A mesterséges intelligencia technológia gyors fejlődése miatt együttműködésen alapuló megközelítésre van szükség a biztonságos fejlesztés érdekében.

A fejlett mesterséges intelligencia biztonságáról szóló nemzetközi tudományos jelentés platformként szolgál a mesterséges intelligencia biztonságával kapcsolatos legjobb tudományos kutatások összefogására a világ minden tájáról, 30 vezető mesterséges intelligenciával foglalkozó nemzet képviselői, köztük az Egyesült Királyság, az Egyesült Államok, Kína, Franciaország és a Koreai Köztársaság, valamint az EU és az ENSZ képviselői.

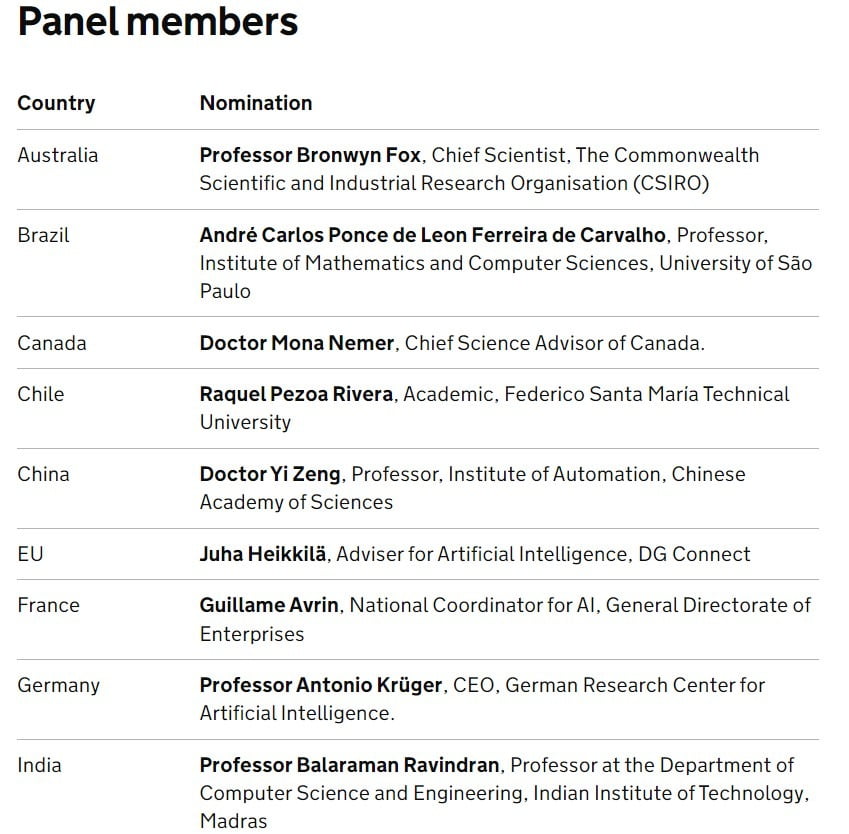

A szakértői tanácsadó testület 32 kiemelkedő nemzetközi személyiségből áll, akiket saját nemzetük jelölt.

E szakértők között olyan neves személyiségek vannak, mint Dr. Hiroaki Kitano, a japán Sony technológiai igazgatója és Amandeep Gill, az ENSZ technológiai megbízottja.

A testület tagja még az Egyesült Királyság tudományos főtanácsadója, Dame Angela McLean, valamint többek között Franciaország, Németország, Ausztrália és Kína képviselői.

A jelentés két változata

A fejlett mesterséges intelligencia biztonságáról szóló nemzetközi tudományos jelentés két iterációban jelenik meg.

Az első eredményeket a tervek szerint a Koreai Köztársaság tavaszi mesterséges intelligencia biztonsági csúcstalálkozója előtt teszik közzé, lehetővé téve a fontos felismerések időben történő terjesztését.

A második kiadvány a Franciaországban megrendezésre kerülő tárgyalásokkal egy időben jelenik meg, ami még inkább előmozdítja a mesterséges intelligencia biztonságáról szóló globális beszélgetést.

A jelentés alapelvei

A mesterséges intelligenciával kapcsolatos kockázatok szilárd és kiegyensúlyozott értékelésének biztosítása érdekében a jelentés a hasonló kezdeményezések legjobb gyakorlatai által inspirált vezérelveket követi.

Ezek az elvek közé tartozik a teljesség, az objektivitás, az átláthatóság és a tudományos értékelés.

A mesterséges intelligenciával kapcsolatos biztonsági csúcstalálkozó öröksége

A fejlett mesterséges intelligencia biztonságáról szóló nemzetközi tudományos jelentés az Egyesült Királyságban tartott mesterséges intelligencia biztonsági csúcstalálkozó örökségére épül.

A csúcstalálkozón, ahol a jelentést először jelentették be, a legfontosabb érdekelt felek és szakértők találkoztak, hogy megvitassák a mesterséges intelligencia biztonságával kapcsolatos kihívásokat és lehetőségeket.

Az AI biztonsági csúcstalálkozók jövője

A fejlett mesterséges intelligencia biztonságáról szóló nemzetközi tudományos jelentés a jövőbeni mesterséges intelligencia biztonsági csúcstalálkozókon folytatott megbeszélésekhez nyújt tájékoztatást és alakítja azokat.

A tervek szerint 2024-ben két csúcstalálkozóra kerül sor, amelyeknek Dél-Korea és Franciaország ad otthont.

Ezek az összejövetelek lehetőséget biztosítanak a politikai döntéshozók, kutatók és érdekelt felek számára, hogy találkozzanak és a jelentés megállapításain alapuló, a mesterséges intelligencia biztonságára vonatkozó innovatív megközelítéseket vizsgálják meg.

Gyakran ismételt kérdések:

- Mi az International Scientific Report on Advanced AI Safety?

Egy globális együttműködési jelentés, amely a mesterséges intelligenciabiztonságos fejlesztésére összpontosít, és a kockázatokkal és etikai aggályokkal foglalkozik. - Mely országok vesznek részt ebben a jelentésben?

Több mint 30 ország, köztük az Egyesült Királyság, az Egyesült Államok, Kína, Franciaország és a Koreai Köztársaság vesz részt a jelentésben. - Melyek a jelentésben tárgyalt főbb aggályok?

A jelentés a mesterséges intelligencia fejlesztésének lehetséges torzításaira, etikai aggályaira és nem szándékolt következményeire összpontosít. - Kik vesznek részt a szakértői tanácsadó testületben?

A testület 32 nemzetközi személyiséget foglal magában, köztük Dr. Hiroaki Kitanót és Amandeep Gillt. - Hogyan fogja ez a jelentés befolyásolni a mesterséges intelligencia biztonságát?

Célja, hogy irányt mutasson a mesterséges intelligencia biztonságáról szóló globális vitáknak és szakpolitikáknak, biztosítva a felelős mesterséges intelligencia fejlesztését.