Last Updated on August 29, 2024 12:36 pm by Laszlo Szabo / NowadAIs | Published on August 28, 2024 by Laszlo Szabo / NowadAIs

Meta AI stellt Sapiens vor: Ein neues Modell zur Analyse menschlicher Handlungen – Key Notes

- Das Modell Sapiens von Meta AI konzentriert sich auf die Analyse menschlicher Handlungen in Bildern und Videos und zeichnet sich durch eine hohe Komplexität aus.

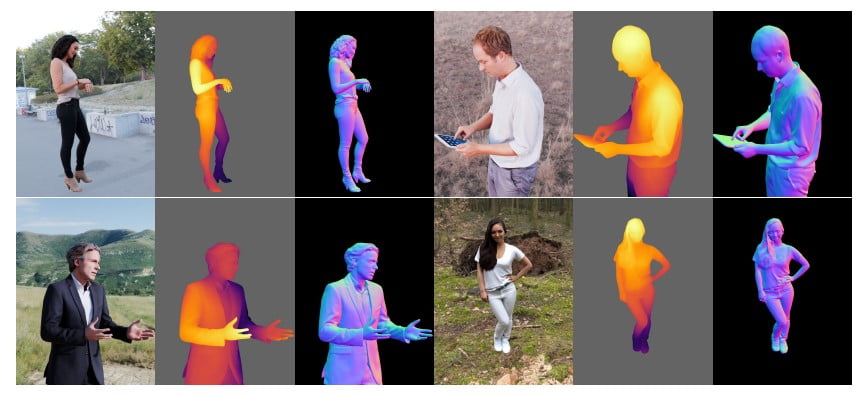

- Sapiens bewältigt wichtige Aufgaben wie 2D-Positionsschätzung, Segmentierung von Körperteilen, Tiefenschätzung und Vorhersage von Oberflächennormalen.

- Sapiens wurde mit über 300 Millionen Bildern trainiert und erbringt gute Leistungen mit begrenzten gelabelten Daten und ist für eine verbesserte Leistung erweiterbar.

- Das Modell verwendet die Vision Transformers-Architektur und ist für hochauflösende Aufgaben mit einer Vielzahl von Einsatzoptionen optimiert.

Sapiens von Meta AI: Eine neue KI-Lösung

Meta AI hat sein neues Modell Sapiens vorgestellt, das speziell für die Analyse und das Verständnis der Handlungen von Menschen in Bildern und Videos konzipiert ist. Das von Meta Reality Labs entwickelte Modell bietet hochauflösende Fähigkeiten für Aufgaben des menschlichen Sehens, wobei der Schwerpunkt auf dem Verstehen und Analysieren von Menschen in Bildern und Videos liegt. Zu diesen Aufgaben gehören die Erkennung menschlicher Posen, die Segmentierung von Körperteilen, die Tiefenmessung und die Bestimmung der Ausrichtung von Objektoberflächen. Das Modell wurde mit über 300 Millionen Bildern von Menschen trainiert und kann auch in komplexen Umgebungen gute Leistungen erbringen. Es hat auch bewiesen, dass es mit minimalen markierten Daten und sogar mit synthetischen Daten effektiv arbeitet, was es zu einem wertvollen Werkzeug für reale Anwendungen macht, bei denen die Datenmenge begrenzt ist. Darüber hinaus ist das Sapiens-Modell leicht erweiterbar und erzielt bessere Ergebnisse, wenn die Anzahl der Parameter erhöht wird.

Wichtige Aufgaben des menschlichen Sehens, die das Sapiens-Modell bewältigt

Das Sapiens-Modell ist in der Lage, verschiedene Aufgaben des menschlichen Sehens zu bewältigen, was es vielseitig für unterschiedliche Anwendungen einsetzbar macht. Es zeichnet sich durch Aufgaben wie Posenschätzung, Segmentierung von Körperteilen, Tiefenschätzung und Vorhersage von Oberflächennormalen aus und liefert präzise und umfassende Analysen in komplexen Szenarien.

2D-Positionsabschätzung: Menschliche Bewegungen mit Präzision erkennen

Eine der wichtigsten Aufgaben, für die das Sapiens-Modell eingesetzt wird, ist die 2D-Positionsbestimmung. Diese KI-Technologie ist in verschiedenen Bereichen wie Videoüberwachung, virtuelle Realität, Bewegungserfassung, medizinische Rehabilitation usw. unverzichtbar, da sie menschliche Posen, Bewegungen und Gesten erkennen kann. Das Modell erkennt und prognostiziert präzise die wichtigsten Punkte des menschlichen Körpers, selbst in Szenen mit mehreren Personen, was es für die Bewegungsanalyse und die Mensch-Computer-Interaktion nützlich macht.

Segmentierung von Körperteilen: Anwendungen in der medizinischen Bildgebung und der virtuellen Anprobe

Eine weitere wichtige Anwendung des Sapiens-Modells ist die Segmentierung von Körperteilen, die in Bereichen wie der medizinischen Bildanalyse, der virtuellen Anpassung, der Animationsproduktion und der erweiterten Realität von entscheidender Bedeutung ist. Das Modell ist in der Lage, jedes Pixel eines Bildes genau in verschiedene Körperteile zu klassifizieren, z. B. Ober- und Unterkörper, Gesichtsdetails usw. Diese Funktion ist für die Entwicklung fortschrittlicher virtueller Kleidungsanpassungen, medizinischer Diagnosetools und natürlicherer virtueller Charakteranimationen von Vorteil.

Tiefenabschätzung: Verstehen von 3D-Strukturen in komplexen Szenarien

Die Tiefenschätzung ist eine weitere wichtige Aufgabe, bei der sich das Sapiens-Modell auszeichnet. Dies ist für das autonome Fahren, die Roboternavigation, die 3D-Modellierung und die virtuelle Realität unerlässlich, da es hilft, die dreidimensionale Struktur der Szene zu verstehen. Das Modell ist in der Lage, aus einem einzigen Bild Tiefeninformationen abzuleiten, insbesondere bei menschlichen Szenen. Diese Funktion unterstützt verschiedene Anwendungen, die ein Verständnis der räumlichen Beziehungen erfordern, z. B. die Hinderniserkennung beim autonomen Fahren und die Pfadplanung von Robotern.

Vorhersage von Oberflächennormalen für hochqualitatives 3D-Rendering

Die Vorhersage der Oberflächennormalen, die beim 3D-Rendering, bei der physikalischen Simulation, beim Reverse Engineering und bei der Beleuchtungsverarbeitung weit verbreitet ist, ist ebenfalls eine Spezialität des Sapiens-Modells. Es kann die Richtung der Oberflächennormalen jedes Pixels in einem Bild ableiten, was für die Erstellung hochwertiger 3D-Modelle und die Erzielung realistischerer Beleuchtungseffekte entscheidend ist. Diese Funktion ist besonders wichtig für Anwendungen, die präzise Oberflächenmerkmale erfordern, wie z. B. die virtuelle Realität und die Erstellung digitaler Inhalte.

Vielseitigkeit von Sapiens bei verschiedenen Aufgaben des menschlichen Sehens

Die Vielseitigkeit des Sapiens-Modells zeigt sich in seiner Fähigkeit, verschiedene auf den Menschen ausgerichtete Sehaufgaben zu bewältigen, was es zu einem nützlichen Werkzeug in Szenarien wie der Analyse von Social-Media-Inhalten, der Sicherheitsüberwachung, der sportwissenschaftlichen Forschung und der Erzeugung digitaler Menschen macht. Aufgrund seiner starken Leistung bei mehreren Aufgaben kann das Sapiens-Modell als allgemeines Basismodell zur Unterstützung verschiedener menschenzentrierter Sehaufgaben dienen und die Entwicklung entsprechender Anwendungen beschleunigen.

Verbesserung von Virtual- und Augmented-Reality-Erlebnissen mit Sapiens

Virtual-Reality- und Augmented-Reality-Anwendungen erfordern ein genaues Verständnis der menschlichen Haltung und Struktur, um ein immersives Erlebnis zu schaffen. Das Sapiens-Modell bietet hochauflösende, genaue menschliche Posen und Teilsegmentierungen und eignet sich daher für die Erstellung realistischer menschlicher Bilder in virtuellen Umgebungen. Außerdem kann es sich dynamisch an die Bewegungen des Benutzers anpassen.

Sapiens in medizinischen und gesundheitlichen Anwendungen: Bessere Patientenversorgung

In der Medizin und im Gesundheitswesen können die genaue Haltungserkennung und die Segmentierung des Menschen durch das Sapiens-Modell bei der Patientenüberwachung, der Behandlungsverfolgung und der Rehabilitationsberatung helfen. Dieses Modell hilft medizinischen Fachkräften, die Haltung und Bewegung von Patienten zu analysieren, um personalisierte und effektive Behandlungspläne zu erstellen.

Technische Merkmale und Methoden des Sapiens-Modells

Zu den technischen Methoden des Sapiens-Modells gehört die Verwendung des Humans-300M-Datensatzes für das Vortraining, der 300 Millionen “in-the-wild”-Bilder von Menschen enthält. Der Datensatz wurde sorgfältig kuratiert, um die Datenqualität zu gewährleisten. Das Modell verwendet außerdem die Vision Transformers (ViT)-Architektur, die das Bild in nicht überlappende Bereiche unterteilt, um eine bessere Verarbeitung von hochauflösenden Eingaben zu ermöglichen. Die Architektur des Modells besteht aus einem Encoder für die Merkmalsextraktion und einem Decoder für aufgabenspezifische Funktionen. Das Pre-Training erfolgt mit der Masked Autoencoder (MAE)-Methode, die es dem Modell ermöglicht, robustere Merkmalsrepräsentationen zu erlernen. Das Modell wird auch auf qualitativ hochwertigen markierten Daten vortrainiert und verwendet mehrere Aufgaben wie 2D-Positionsschätzung, Segmentierung von Körperteilen, Tiefenschätzung und Vorhersage von Oberflächennormalen. Es wird mit Hilfe des AdamW-Optimierers mit Cosinus-Annealing- und Linear-Decay-Lernratenstrategien optimiert. Schließlich zeigt das Modell auch bei begrenzten Trainingsdaten umfangreiche Generalisierungsfähigkeiten bei Nullschüssen.

Schlussfolgerung: Sapiens als wertvolles Werkzeug für menschenzentrierte Sehaufgaben

Zusammenfassend lässt sich sagen, dass das Sapiens-Modell ein leistungsfähiges Werkzeug für verschiedene Aufgaben im Bereich des menschlichen Sehens ist, da es in der Lage ist, die Handlungen von Menschen in Bildern und Videos genau zu analysieren und zu verstehen. Seine Leistung übertrifft nachweislich bestehende Methoden, was es zu einem wertvollen Hilfsmittel in verschiedenen Anwendungen macht.

Beschreibungen

- 2D-Positionsabschätzung: Ein Prozess, bei dem das Modell Schlüsselpunkte des menschlichen Körpers, wie z. B. Gelenke, erkennt und vorhersagt, um Posen und Bewegungen zu bestimmen. Dies ist entscheidend für Bereiche wie virtuelle Realität und medizinische Rehabilitation.

- Segmentierung von Körperteilen: Die Klassifizierung jedes Pixels in einem Bild in verschiedene Körperteile, was bei Anwendungen wie medizinischer Bildgebung, virtueller Anpassung und erweiterter Realität zu einem detaillierten Verständnis und einer besseren Visualisierung beiträgt.

- Tiefenabschätzung: Eine Technik, die die Entfernung von Objekten in einem Bild ermittelt und Maschinen hilft, dreidimensionale Räume zu verstehen. Nützlich in der Robotik, beim autonomen Fahren und in der virtuellen Realität für Aufgaben wie die Hinderniserkennung.

- Vorhersage der Oberflächennormalen: Die Bestimmung der Richtung senkrecht zu einer Oberfläche an jedem Pixel, die beim 3D-Rendering und der Erzielung realistischer Lichteffekte in virtuellen Simulationen und digitalen Kreationen hilft.

- Vision Transformers (ViT): Eine KI-Architektur, die Bilder verarbeitet, indem sie sie in kleinere Patches unterteilt, was eine bessere Verarbeitung von hochauflösenden Eingaben ermöglicht und die Modellgenauigkeit und -effizienz verbessert.

- Maskierter Autoencoder (MAE): Eine Trainingstechnik, bei der Teile des Inputs maskiert oder ausgeblendet werden, so dass das Modell durch Vorhersage der fehlenden Teile robustere Darstellungen erlernen kann.

- Zero-Shot-Generalisierung: Die Fähigkeit des Modells, gelerntes Wissen ohne zusätzliches Training auf neue, unbekannte Aufgaben anzuwenden, was Vielseitigkeit und Anpassungsfähigkeit demonstriert.

Häufig gestellte Fragen

- Was ist das Sapiens-Modell von Meta AI? Sapiens von Meta AI ist ein Modell, das für die Analyse menschlicher Handlungen in Bildern und Videos entwickelt wurde. Es zeichnet sich durch Aufgaben wie Posenschätzung, Segmentierung von Körperteilen und Tiefenschätzung aus, um komplexe visuelle Daten zu verstehen.

- Wie führt Meta AI’s Sapiens 2D-Positionsschätzungen durch? Das Sapiens-Modell verwendet fortschrittliche Algorithmen zur Erkennung und Vorhersage von Schlüsselpunkten des menschlichen Körpers und identifiziert Posen und Bewegungen selbst in überfüllten Szenen. Dies macht es ideal für die Überwachung, virtuelle Realität und das Gesundheitswesen.

- Warum ist die Segmentierung von Körperteilen bei Sapiens von Meta AI so wichtig? Die Segmentierung von Körperteilen hilft bei der Zuordnung jedes Pixels zu bestimmten Körperteilen, was für Anwendungen wie die medizinische Bildgebung, die virtuelle Anprobe von Kleidung und die Erstellung lebensechter Animationen in der erweiterten Realität entscheidend ist.

- Wie funktioniert die Tiefenabschätzung in Sapiens von Meta AI? Die Tiefenschätzung in Sapiens ermöglicht es dem Modell, die dreidimensionale Struktur einer Szene anhand eines einzigen Bildes zu verstehen. Dies ist nützlich für die Roboternavigation, das autonome Fahren und die Schaffung immersiver virtueller Umgebungen.

- Auf welchen Technologien basiert das Sapiens-Modell? Sapiens von Meta AI basiert auf der Vision Transformers (ViT)-Architektur und verwendet einen Masked Autoencoder (MAE) für das Training. Es nutzt einen großen Datensatz und hochentwickelte Algorithmen für eine robuste Leistung.