Last Updated on Februar 2, 2024 11:24 am by Laszlo Szabo / NowadAIs | Published on Februar 2, 2024 by Juhasz “the Mage” Gabor

KI-Sicherheit: Globale Anstrengungen für eine sichere Entwicklung der künstlichen Intelligenz – Wichtige Hinweise

- Globale Zusammenarbeit: Unter Beteiligung von 30 führenden KI-Nationen.

- Expertenbeirat: Besteht aus 32 internationalen Experten.

- Schwerpunktbereiche: Risiken, ethische Bedenken und unbeabsichtigte Folgen der KI.

- Leitprinzipien: Ausführlichkeit, Objektivität, Transparenz und wissenschaftliche Bewertung.

- Künftiger Einfluss: Gestaltung der Diskussionen auf künftigen KI-Sicherheitsgipfeln.

Globaler Bedarf an Sicherheit

Künstliche Intelligenz (KI) hat sich zu einer transformativen Technologie mit einem immensen Potenzial für Innovation und Fortschritt entwickelt.

Da KI-Systeme jedoch immer ausgefeilter werden, besteht ein wachsender Bedarf, sich mit den Sicherheitsbedenken im Zusammenhang mit ihrer Entwicklung und ihrem Einsatz auseinanderzusetzen.

Um dieses Problem anzugehen, ist eine internationale Zusammenarbeit im Gange, um den ersten internationalen wissenschaftlichen Bericht über fortgeschrittene KI-Sicherheit zu erstellen.

Einführung in die Sicherheit künstlicher Intelligenz

Die Sicherheit künstlicher Intelligenz oder KI-Sicherheit bezieht sich auf die Maßnahmen, die ergriffen werden, um sicherzustellen, dass KI-Systeme auf sichere und verantwortungsvolle Weise entwickelt und eingesetzt werden.

Dabei geht es um die Bewältigung der Risiken und Herausforderungen, die mit KI verbunden sind, z. B. potenzielle Verzerrungen, ethische Bedenken und unbeabsichtigte Folgen.

Der internationale wissenschaftliche Bericht über die Sicherheit fortgeschrittener KI zielt darauf ab, ein umfassendes Verständnis dieser Risiken und Fähigkeiten der Pionier-KI zu vermitteln.

Beratendes Expertengremium: Eine globale Zusammenarbeit

Der rasche Fortschritt der KI-Technologie erfordert einen kooperativen Ansatz, um ihre sichere Entwicklung zu gewährleisten.

Der International Scientific Report on Advanced AI Safety dient als Plattform, um die besten wissenschaftlichen Forschungsergebnisse zur KI-Sicherheit aus der ganzen Welt zu bündeln. Daran beteiligt sind Vertreter von 30 führenden KI-Nationen, darunter das Vereinigte Königreich, die USA, China, Frankreich und die Republik Korea, sowie die EU und die UN.

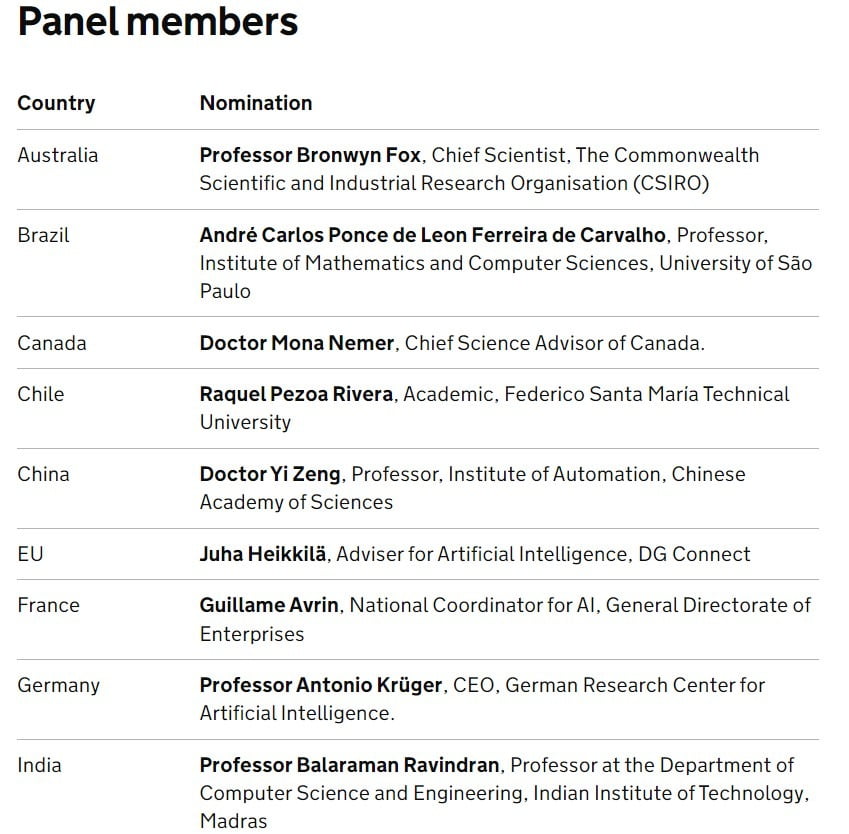

Der Expertenbeirat besteht aus 32 prominenten internationalen Persönlichkeiten, die von ihren jeweiligen Ländern nominiert wurden.

Unter diesen Experten befinden sich renommierte Persönlichkeiten wie Dr. Hiroaki Kitano, der CTO von Sony, Japan, und Amandeep Gill, der UN-Beauftragte für Technologie.

Dem Gremium gehören auch die wissenschaftliche Chefberaterin des Vereinigten Königreichs, Dame Angela McLean, sowie Vertreter aus Frankreich, Deutschland, Australien und China an.

Zwei Versionen des Berichts

Der Internationale Wissenschaftliche Bericht über fortgeschrittene KI-Sicherheit wird in zwei Auflagen veröffentlicht.

Die ersten Ergebnisse sollen noch vor dem KI-Sicherheitsgipfel in der Republik Korea im Frühjahr veröffentlicht werden, um eine rechtzeitige Verbreitung wichtiger Erkenntnisse zu ermöglichen.

Eine zweite Veröffentlichung wird zeitgleich mit den von Frankreich veranstalteten Gesprächen erfolgen, um die globale Diskussion über KI-Sicherheit weiter voranzutreiben.

Leitprinzipien für den Bericht

Um eine solide und ausgewogene Bewertung der KI-Risiken zu gewährleisten, folgt der Bericht einer Reihe von Leitprinzipien, die sich an bewährten Verfahren ähnlicher Initiativen orientieren.

Zu diesen Grundsätzen gehören Vollständigkeit, Objektivität, Transparenz und wissenschaftliche Bewertung.

Das Vermächtnis des KI-Sicherheitsgipfels

Der internationale wissenschaftliche Bericht über fortgeschrittene KI-Sicherheit baut auf dem Erbe des KI-Sicherheitsgipfels im Vereinigten Königreich auf.

Der Gipfel, auf dem der Bericht erstmals angekündigt wurde, brachte wichtige Interessenvertreter und Experten zusammen, um die Herausforderungen und Chancen der KI-Sicherheit zu diskutieren.

Die Zukunft von KI-Sicherheitsgipfeln

Der internationale wissenschaftliche Bericht über fortgeschrittene KI-Sicherheit wird die Diskussionen auf künftigen KI-Sicherheitsgipfeln beeinflussen und prägen.

Für das Jahr 2024 sind zwei Gipfeltreffen geplant, die von Südkorea und Frankreich ausgerichtet werden.

Diese Gipfeltreffen bieten politischen Entscheidungsträgern, Forschern und Interessenvertretern die Gelegenheit, innovative Ansätze für die KI-Sicherheit auf der Grundlage der Ergebnisse des Berichts zu erkunden.

Häufig gestellte Fragen:

- Was ist der Internationale Wissenschaftliche Bericht über die Sicherheit fortgeschrittener KI?

Ein globaler gemeinsamer Bericht, der sich auf die sichere Entwicklung von KI konzentriert und sich mit Risiken und ethischen Bedenken befasst. - Welche Länder sind an diesem Bericht beteiligt?

Über 30 Länder, darunter das Vereinigte Königreich, die USA, China, Frankreich und die Republik Korea, leisten einen Beitrag. - Wer gehört dem beratenden Expertengremium an?

Dem Gremium gehören 32 internationale Persönlichkeiten an, darunter Dr. Hiroaki Kitano und Amandeep Gill. - Welchen Einfluss wird dieser Bericht auf die KI-Sicherheit haben?

Der Bericht zielt darauf ab, globale Diskussionen und Strategien zur KI-Sicherheit zu lenken und eine verantwortungsvolle KI-Entwicklung zu gewährleisten.